ChatGPTを使いはじめたころ、操作自体はすんなり覚えられた。でも、生成AIへの入力で「境界線」がわからなくて、毎回止まっていた。

テキストを入力して、送信する。それだけ。 難しいことは何もなくて、返ってくる答えもおもしろくて、「あ、これいけるな」って感触はわりと早い段階であった。

なのに、入力する前に毎回ちょっと止まる。

その「止まり」が、しばらく続いた。

「これ、打ち込んでいいやつ?」

仕事でAIを使おうとしたとき、最初に頭に浮かんだのがこれだった。

会社の資料、取引先の名前、自分が関わっているプロジェクトの内容。 全部ぼかして入れればいいのか、そもそも入れないほうがいいのか。 ネットで調べても「ケースバイケース」みたいな答えが多くて、結局よくわからないまま終わる。

操作の仕方を解説している記事はたくさんあるのに、「何を入れてはいけないか」を丁寧に教えてくれる記事ってほとんどない。あっても難しすぎるか、大企業向けすぎるか。

「なんとなく怖い」まま、使えない時期がしばらく続いた。

生成AIの入力境界線、ChatGPTに直接聞いてみた

ある日ふと、「もうAI本人に聞けばいいじゃん」と思って、こう入力してみた。

💬 ChatGPTへの投げかけ

「生成AIに情報を入力するとき、入れていいもの・注意が必要なもの・入れてはいけないものを初心者にもわかるように3段階で整理してください。具体例もつけてください。」

返ってきた答えがこれ↓(一部抜粋)

NIST(アメリカの標準やガイドラインを作る機関)= 安全の教科書

OWASP(セキュリティの危険ポイントをわかりやすくまとめてくれる団体)= 危険ポイント集

ざっくりこういう整理だった。

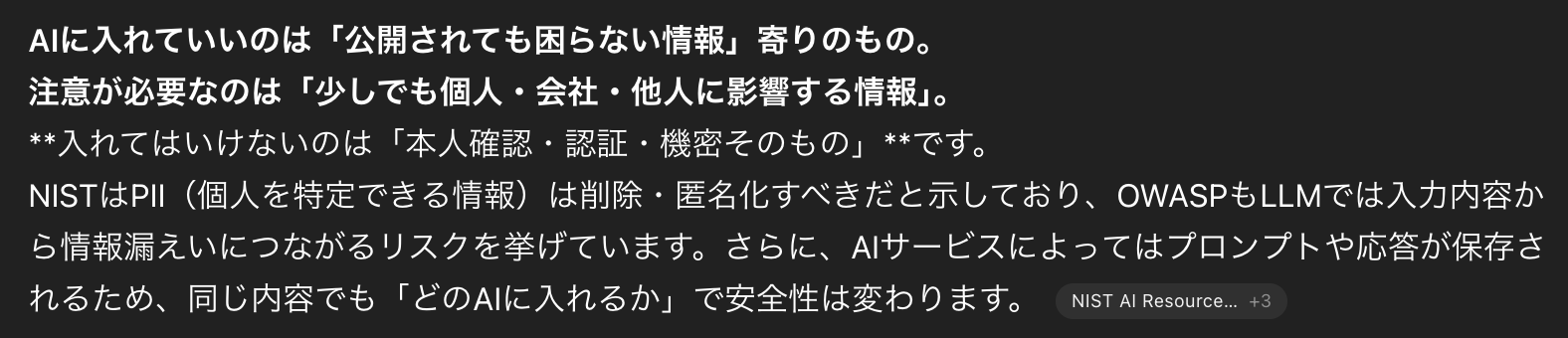

入れていいのは「公開されても困らない情報」。

注意が必要なのは「個人・会社・他人に少しでも影響する情報」。

入れてはいけないのは「本人確認・認証・機密そのもの」。

この分類はわかりやすかった。でもそれより引っかかったのが、最後のこの一文。

「どのAIに入れるかによっても、安全性は変わる」

AIサービスによっては、入力した内容が保存されたり、学習に使われたりするらしい。

これ、考えたことなかったな、と思った。

自分のルールは、シンプルにした

完璧なルールを作ろうとすると、また動けなくなりそうで。 「これだけ守れば動ける」という最低限だけ決めた。

個人名・社名は入れない。

それだけ。

実際には「A社」とか「取引先」とか「担当者」みたいな表現に置き換えてから入力している。内容は伝わるし、誰の話かも特定されない。完璧かどうかはわからないけど、「なんとなく怖い」から「ここまでなら大丈夫」に変わっただけで、使える場面がけっこう増えた。

境界線がわかると、止まらなくなる

プロンプトのテクニックより先に必要だったのは、「この範囲なら安心して使える」という自分なりの基準だったんだと思う。

生成AIへの入力の境界線がわかると、手が止まらなくなる。止まらなくなると、アイデアを考えることに頭を使えるようになる。

まだ全部わかってるわけじゃないし、これで合ってるかも正直自信はない。でも「わからないなりに動ける」状態になれたのは、たぶんここからだった。

▼あわせて読みたい

ChatGPTの答えが変わる!失敗しない質問の仕方と成功の型3選

AIフェイク動画の見分け方:拡散前に3つだけチェックする方法

ChatGPTは次の言葉を予測しているだけ?それでも「わかってくれる」と感じる理由